Corea del Sur se anticipa al futuro del entretenimiento televisivo con Reality de Zero Density

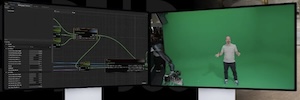

El estudio ROOT Metaverse & Content ha aprovechado la potencia del motor Reality de Zero Density para transformar a varios cantantes en avatares generados en tiempo real, evolucionando de esta forma la premisa del popular concurso Mask Singer.

Avatar Singer (emitido en el canal MBN en horario de máxima audiencia durante cuatro meses) invitó a los espectadores a presenciar actuaciones de un importante número de artistas coreanos de primer nivel que ocultaron su identidad hasta el final. En esta ocasión, no se valieron de grandes disfraces para mantener el misterio, sino que se transformaron en avatares digitales 3D con habilidades únicas “que desafían la física”. Para crear este nuevo formato, se integraron tecnologías vanguardistas como captura de movimiento, captura facial, Unreal DMX (Digital Multiplex) para efectos especiales そして realidad aumentada (RA).

El proceso de creación de los escenarios y los personajes avatar duró tres meses, mientras que las pruebas de captura de movimiento en directo duraron un mes. El equipo de ROOT creó un avatar único para cada cantante mediante modelado 3D そして rigging, asegurándose de que cada avatar reflejara la personalidad escénica del cantante y le permitiera conectar emocionalmente con el público. Para dar vida a los avatares, todos los datos de movimiento de los cantantes se grabaron mediante captura de movimiento. La herramienta Live Link の アンリアル エンジン se utilizó para transmitir todos los datos a seis Reality Engines の Zero Density, lo que permitió previsualizar las actuaciones y los efectos visuales en tiempo real.

Reality Engine permitió que los avatares 3D interactuaran con elementos de fantasía sobre el escenario como si estos fueran reales en tiempo real. Del mismo modo, los presentadores そして bailarines pudieron interactuar en tiempo real con estos avatares virtuales, hito que se logró gracias a las capacidades de RealityHub de control de toda la capa gráfica.

¿Te gustó este artículo?

Suscríbete a nuestro RSSフィード Y no te perderás nada.